독자 여러분, 최근 가장 격한 감정에 휩싸였던 순간이 언제인가요? 그때 그 감정을 있는 그대로 속시원하게 모두 표현하셨나요? 지금 이 글을 읽고 계신 분이 성인이라면, 아마 높은 확률로 감정을 최대한 드러내지 않기 위해 참고 또 참으셨을 것 같습니다. 어린 시절에는 기쁨, 분노, 슬픔 등 감정을 솔직하게 나타냈었는데 ‘모난 돌이 정 맞는다’라는 속담 때문인지 나이가 들수록 감정을 억누르는 데 익숙해지는 듯합니다. 이러다 조만간 로봇이 대부분의 인간 어른보다 감정을 더 잘 표현하는 세상이 오지 않을까요?

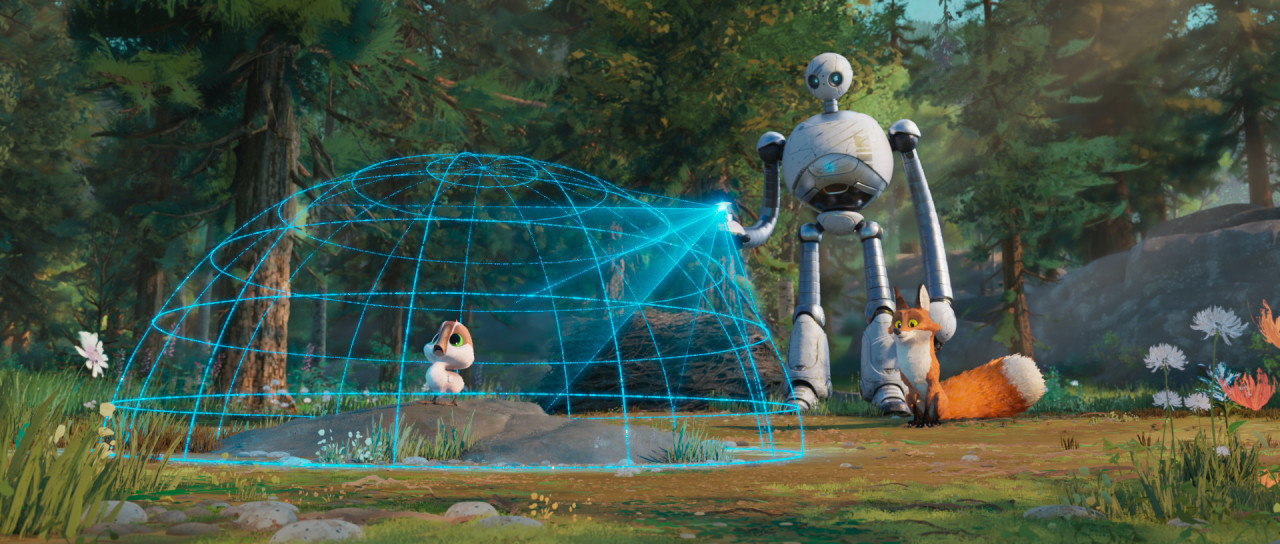

영화 <와일드 로봇>을 본 후 어쩌면 정말 그렇게 될 수도 있겠다는 생각이 들었습니다. 이 영화는 로봇 제작사 ‘유니버설 다이내믹스’의 로봇 ‘로줌 유닛 7134(로즈)’와 아기 기러기 ‘브라트빌’의 가족애, 여우 ‘핑크’를 비롯한 동물들과 로즈의 우정을 매우 감동적으로 그려 냅니다. 어린아이가 보기 좋은 영화라고 생각해 함께 극장을 찾았다가 자신이 눈물을 펑펑 쏟았다고 말하는 부모님들의 후기가 많기도 하죠.

영화 초반, 항공 배송 중 악천후로 외딴 야생 섬에 불시착한 로즈는 자신에게 임무를 부여할 사람을 찾아 헤맵니다. 하지만 사람은 단 한 명도 없고 오직 동물들만 있을 뿐이어서 로즈는 결국 수많은 동물들의 의사소통 방식을 순식간에 학습해 동물들의 말을 이해하게 됩니다. 동물이 내는 소리, 얼굴 표정, 자세, 몸동작 등 동물을 이해할 수 있는 다양한 데이터가 충분히 축적되고 인공지능 학습과 추론을 위한 하드웨어와 모델이 더 고도화된다면 영화에서처럼 동물들의 소리를 인간의 언어로 번역해 주는 서비스도 언젠가 나오지 않을까요?

원래 로즈는 철저히 인간을 도와주는 역할에 충실하도록 설계된 로봇입니다. 로즈는 “로줌 유닛 로봇은 무슨 임무든 기필코 완수합니다”라고 당당히 외치지만 아기 기러기 ‘브라이트빌’에게 먹이를 주고, 수영을 배우게 하고, 나는 법을 가르치는 것은 로즈에게 “프로그래밍된” 임무가 아니었습니다. 그럼에도 불구하고 태생적으로 자신에게 부여된 모든 임무를 완수하도록 프로그래밍된 로즈는 브라이트빌 양육을 자신의 임무로 받아들인 후에는 그 임무를 완수하기 위해 최선을 다합니다.

그저 어떻게든 자신에게 부여된 임무를 완수하고자 ‘기계적으로’ 노력하던 로즈는 어느 순간부터 브라이트빌에게 특별한 ‘감정(과 비슷한 어떤 것)’을 느끼기 시작합니다. 로봇인 로즈는 감정을 느끼지 못하도록 프로그래밍되어 있었지만 브라이트빌을 키우는 임무를 달성하기 위해 스스로 자신의 인지 체계와 작동 방식을 변화시켜 동물의 모성애(와 비슷한 어떤 것)를 내재화한 것입니다.

이러한 로즈의 놀라운 변화는 최근 AI 업계의 화두 중 하나인 ‘인간의 감정을 이해하는 인공지능’ 혹은 ‘스스로 감정을 가진 (것처럼 보이는) 인공지능’과 맥이 닿아 있습니다. 아직까지는 AI가 아무리 발전해도 인간의 감정을 이해하거나 감정을 표현하기는 어려울 것이라고 생각하는 분들이 많을 것 같습니다. 감각을 떼어 놓고서는 감정을 온전히 이해하기 어렵기 때문에 로봇이 인간에 준하는 감각 기관을 갖추어야 ‘인공감정’의 문이 열리기 시작할 듯합니다. 인공지능의 시각과 청각 관련 능력은 이미 엄청난 수준으로 발전했습니다. 인공지능의 후각, 미각, 촉각도 인간만큼 정교해지는 날이 올까요?

올해 노벨 물리학상 수상자는 전통 물리학을 연구한 학자들이라고 보기 어려운 제프리 힌튼과 존 홉필드입니다. 노벨상 심사위원회는 “인공신경망을 활용한 기계학습(머신러닝)을 가능하게 한 근본적 발견과 발명”을 선정 이유로 들었습니다. 두 사람은 물리학적 도구를 써서 기계학습의 기초적 방법론을 개발한 것입니다. ‘인공신경망’은 말 그대로 인간 뇌의 신경망을 본떠서 인공적으로 만든 것입니다. 인공신경망처럼 인간의 신체를 모방한 정교한 AI 모델과 치밀한 공학적 설계가 만나 시너지가 폭발한다면 로봇이 인간과 비슷한 수준의 오감과 감정을 가지게 될지도 모르겠습니다. 최근 스페이스X의 재사용발사체가 하늘 높이 솟았다가 하강한 다음 거대한 로봇 팔에 살포시 안기는 장면을 또 한 번 보고 나니 진짜 가능할 것만 같습니다. 여러분은 어떻게 생각하시나요?

(끝)

글 | 김태혁

'엑쓸신잡 > 영화로운 AI' 카테고리의 다른 글

| AI가 스스로 진화한다면? (영화 ‘트랜센던스’) (1) | 2024.09.26 |

|---|---|

| 전지적 뇌 시점 사회 (영화 ‘써로게이트’) (5) | 2024.08.29 |

| 임박한 ‘1가구 1로봇 집사’ (0) | 2024.07.25 |

| 데이터로 영생하는 시대 (0) | 2024.06.27 |

| 좀비 차가 날 덮친다면? (0) | 2024.05.30 |

댓글